最近几天在B站、抖音、小红书上到处都能刷到OpenClaw的视频,GitHub上232k的Star数也是相当炸裂。看着各路up主演示的效果,我是越看越眼馋,但说实话当时也没什么实际使用需求,就纯粹是看个热闹。

结果就在昨天,老板突然把我叫到办公室:”你看看这个OpenClaw,这么牛逼的AI工具,咱们能不能接入到产品里?这要是用上了,不得美滋滋?”

我当场就懵了——卧槽,这么好的东西我怎么就没想到呢?赶紧回应:”我马上部署一个测试环境,先跑跑看效果怎么样,如果可行咱们立马上!”

于是就有了这篇文章。我会详细记录在Windows系统下部署OpenClaw并接入Qwen3.5 Plus的完整过程,踩过的坑也会一并分享。既是给自己做个备忘,也希望能帮到同样想快速上手测试的朋友们。

话不多说,直接开干!

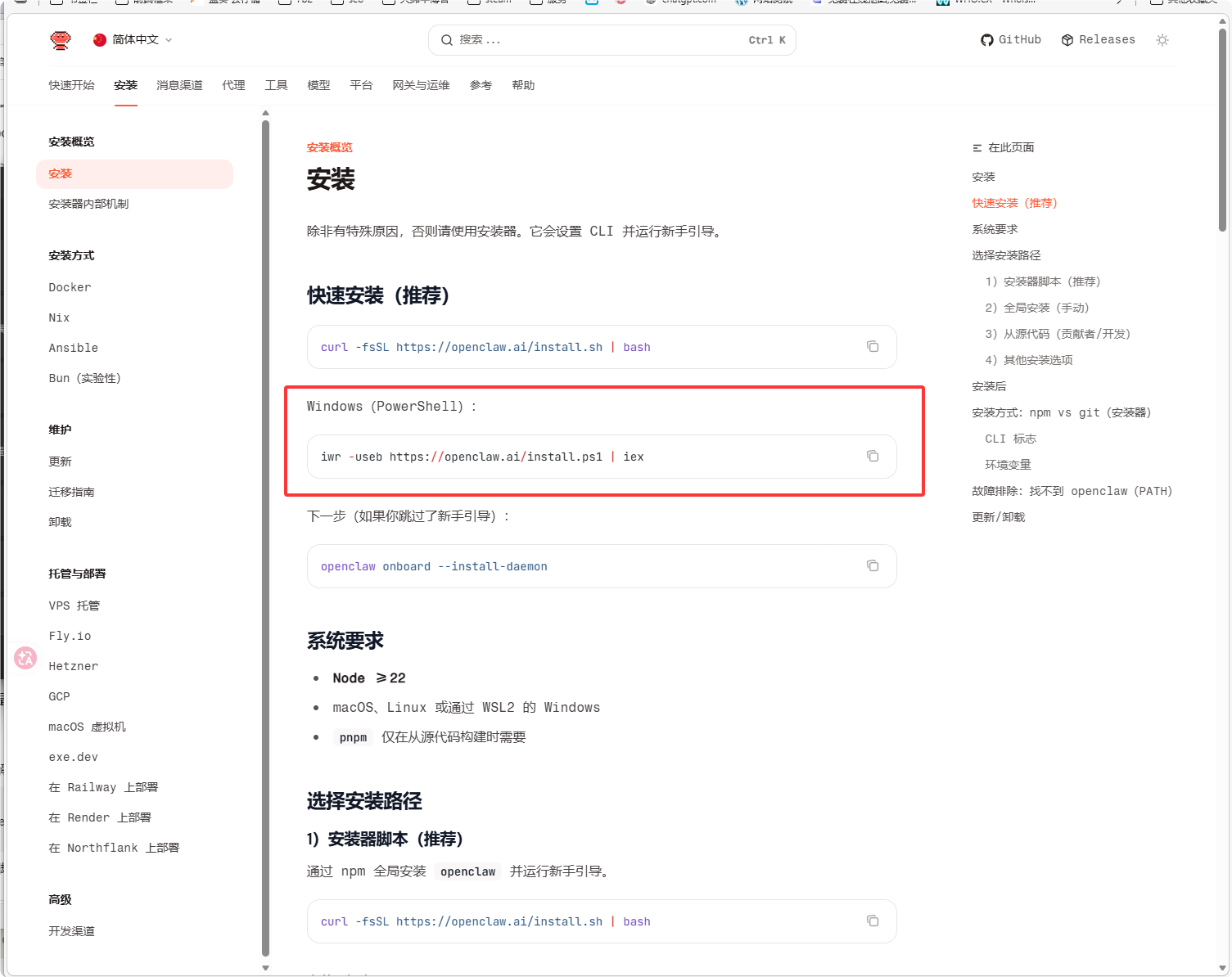

先打开OpenClaw的官方文档

环境准备

最低要求:

- Windows 10(版本 2004+)或 Windows 11

- 8GB 内存(推荐 16GB+)

- 可用磁盘空间 10GB+

- 稳定的网络连接

为了快速部署看个效果本次使用原生windows11部署

1.打开OpenClaw – OpenClaw的官方文档

复制

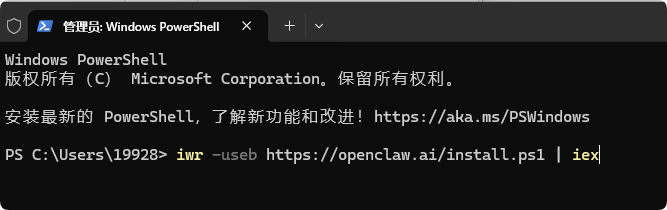

Windows(PowerShell):

iwr -useb https://openclaw.ai/install.ps1 | iex在PowerShell中输入

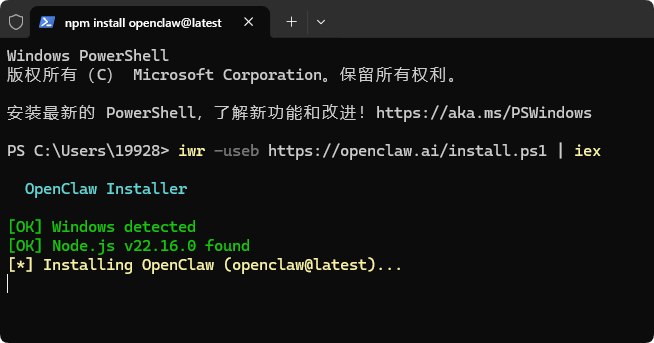

第一次安装OpenClaw会检查电脑中是否有 Node版本 如果你有OpenClaw会自动复用,没有的话会自动安装

看到 [*] Installing OpenClaw (openclaw@latest)… 就说明程序正在安装

OpenClaw installed successfully (2026.2.26)! 代表安装成功

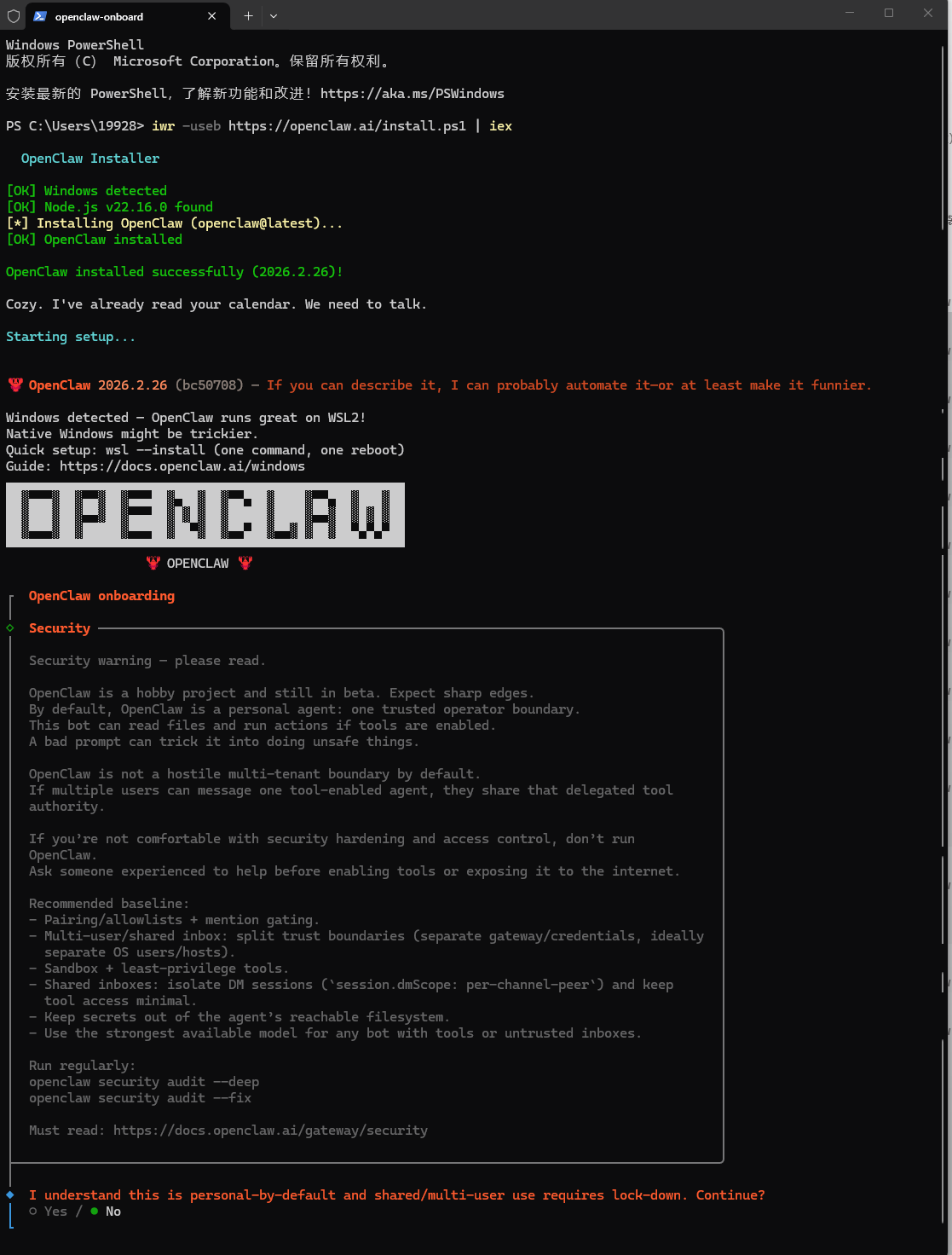

安全确认提示

不出意外的话会自动跳转到这个页面

◆ I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue?

Ps:当前是“默认个人使用模式”如果以后要给多人用或对外开放,需要自己做安全加固现在只是确认你知道这件事

选 Yes 就OK

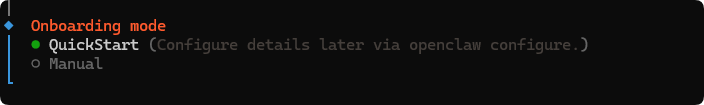

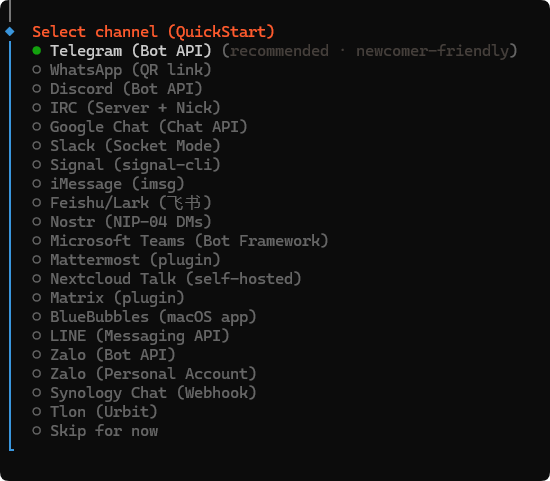

初始化方式选哪种?

有两个选项:

● QuickStart

快速开始模式

自动用默认配置启动

细节以后可以用 openclaw configure 再改

适合新手或只是想先跑起来看看

● Manual

手动配置模式

一开始就自己设置端口、权限、安全等参数

第一次安装直接选择 QuickStart 就OK

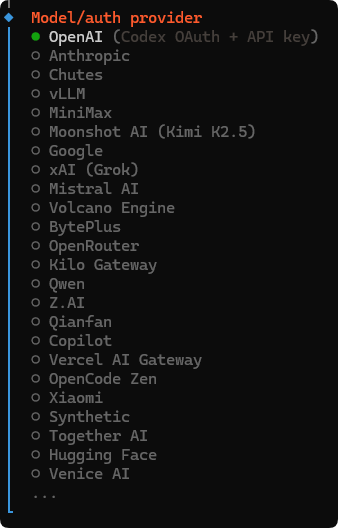

选择模型

我们要配置国内版的阿里云这里选择

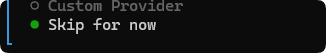

● Skip for now

如果点错了也不要慌,继续下去到时候都是要改的

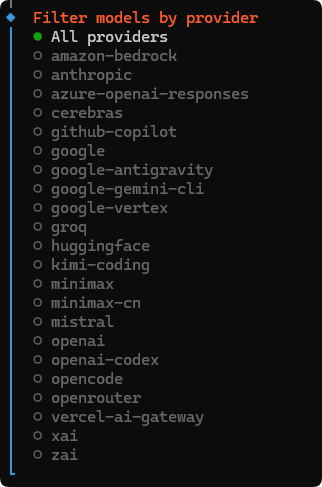

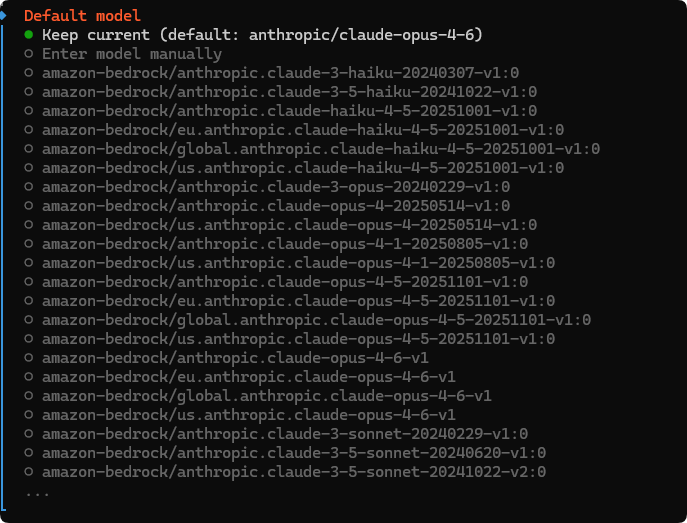

这里默认

直接默认到时候在配置文件中修改

配置社交媒体机器人账号

Ps:我这里需求可以在Web UI 实现 使用我这里就先选择 Skip for now 之后会写一个如何部署钉钉box的教程

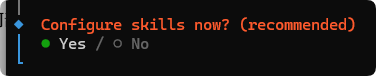

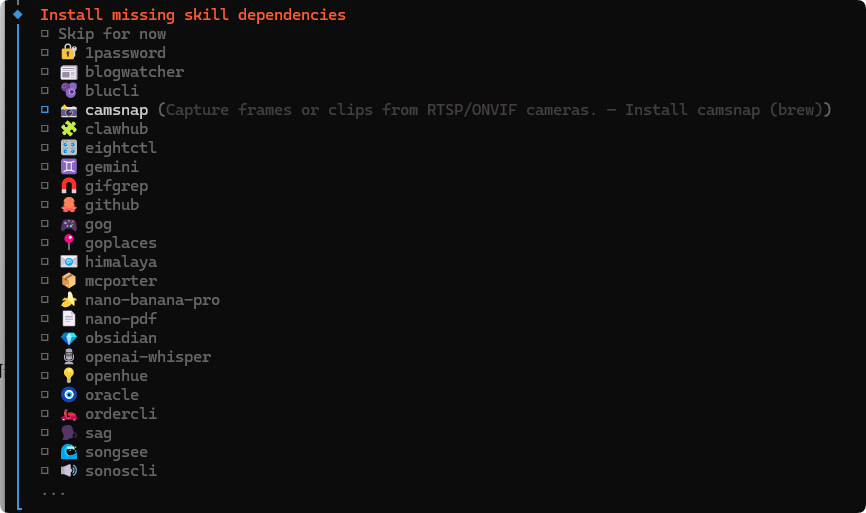

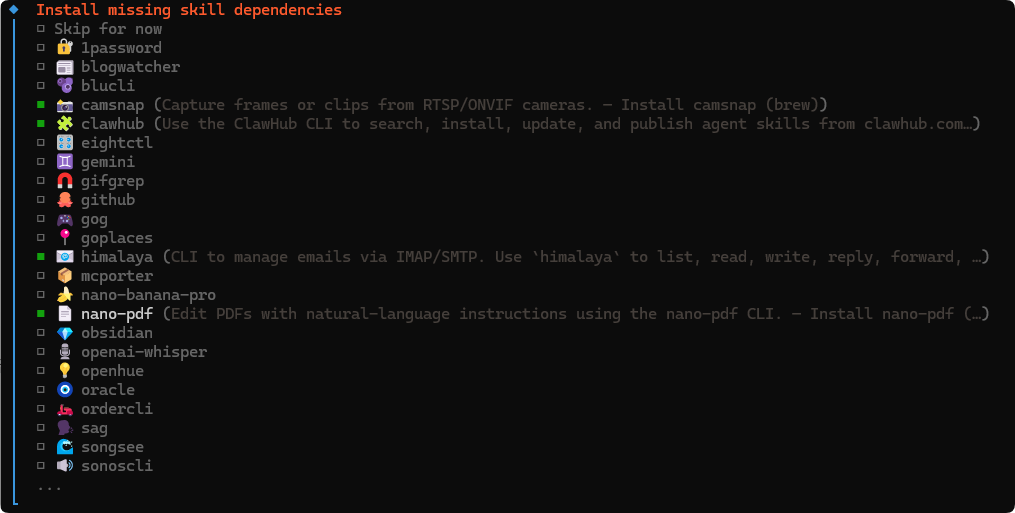

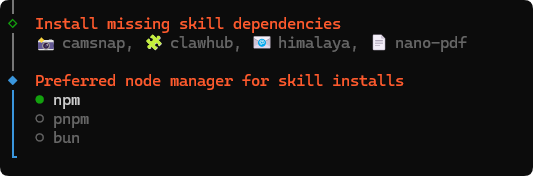

安装&配置技能

选择 Yes

按需求安装 空格选择 回车键确认

选择包安装器

选择npm包管理器或者选择pnpm

扩展功能设置

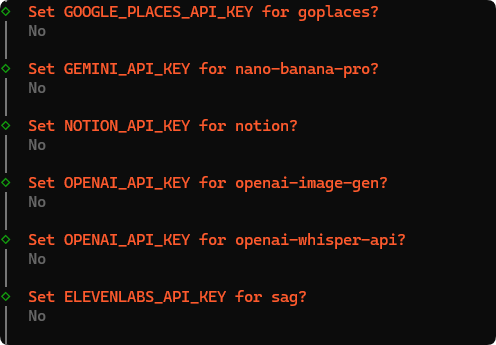

GOOGLE_PLACES_API_KEY(goplaces)

用于调用 Google 地点/地图相关服务

GEMINI_API_KEY(nano-banana-pro)

用于接入 Google Gemini 模型

NOTION_API_KEY(notion)

用于连接 Notion

OPENAI_API_KEY(openai-image-gen)

用于图片生成

OPENAI_API_KEY(openai-whisper-api)

用于语音转文字

ELEVENLABS_API_KEY(sag)

用于语音合成全部选择No 暂时用不上

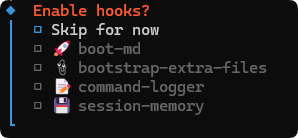

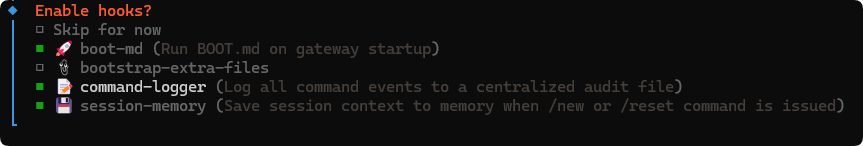

配置hooks钩子

- 🚀 boot-md

启动时自动加载一个 Markdown 文件

类似启动说明或预设提示

一般新手不需要 - 📎 bootstrap-extra-files

启动时自动加载额外文件

用于高级自定义

普通使用不需要 - 📝command-logger

记录执行过的命令

方便排查问题

会保存执行记录 - 💾session-memory

保存会话记忆

让它在不同会话之间保留上下文

适合长期项目使用

可以选择

boot-md

session-memory

command-logger

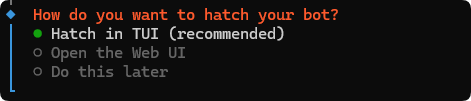

设置UI界面

选择Open the Web UI 方便操作

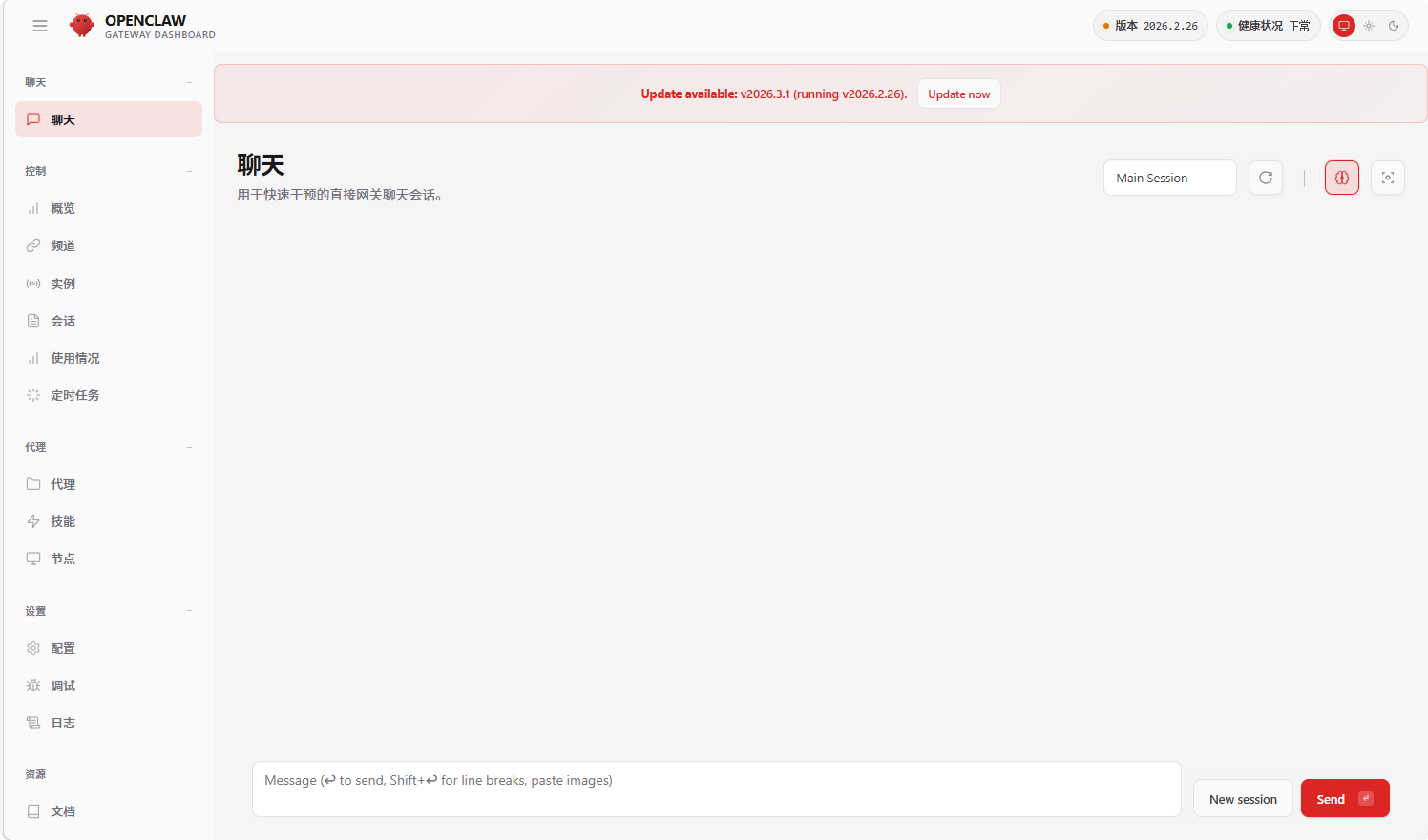

选择完成后会立马打开Web UI的页面

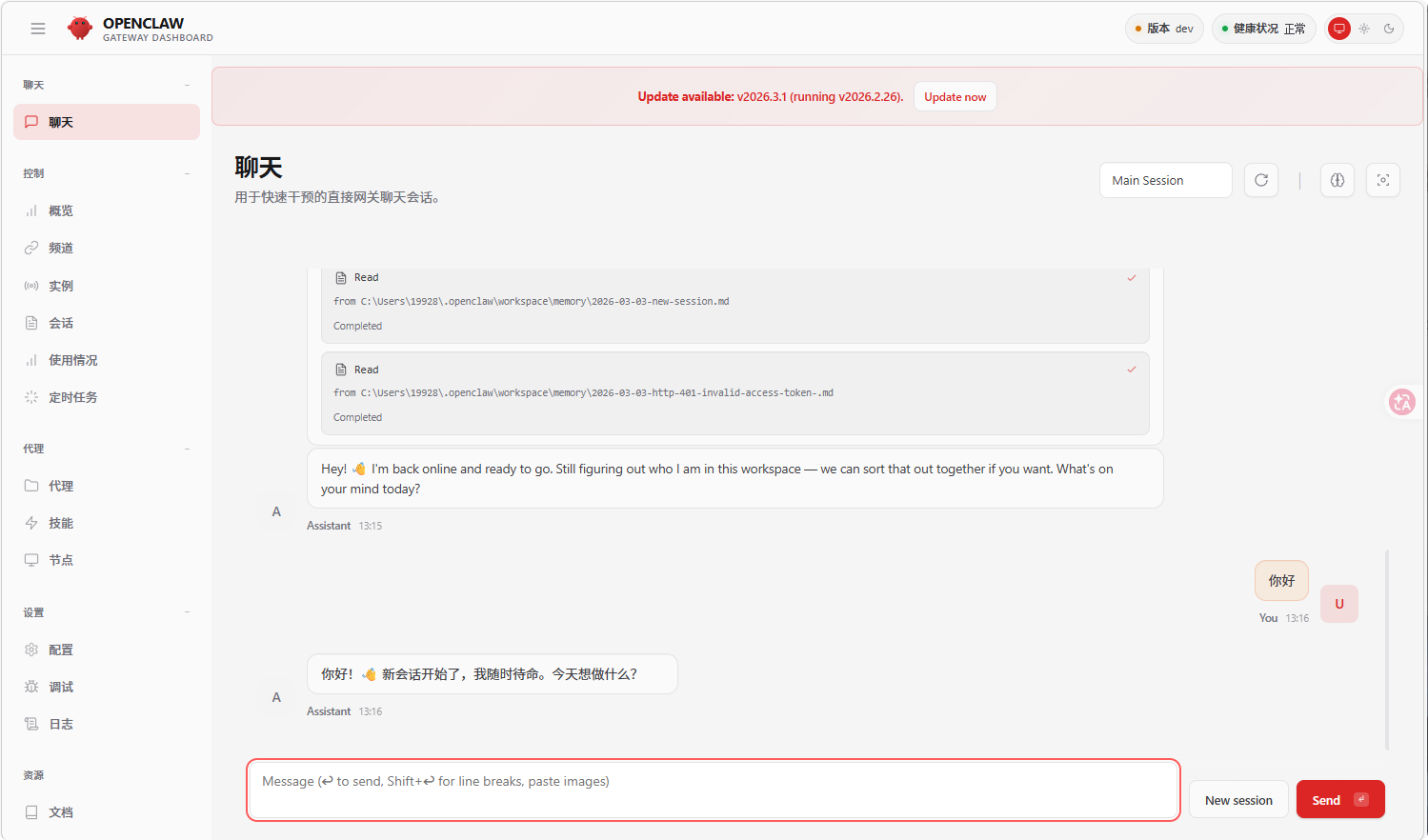

这说明OpenClaw安装完成,但是还不能用,因为还没配置大模型(ing

配置大模型

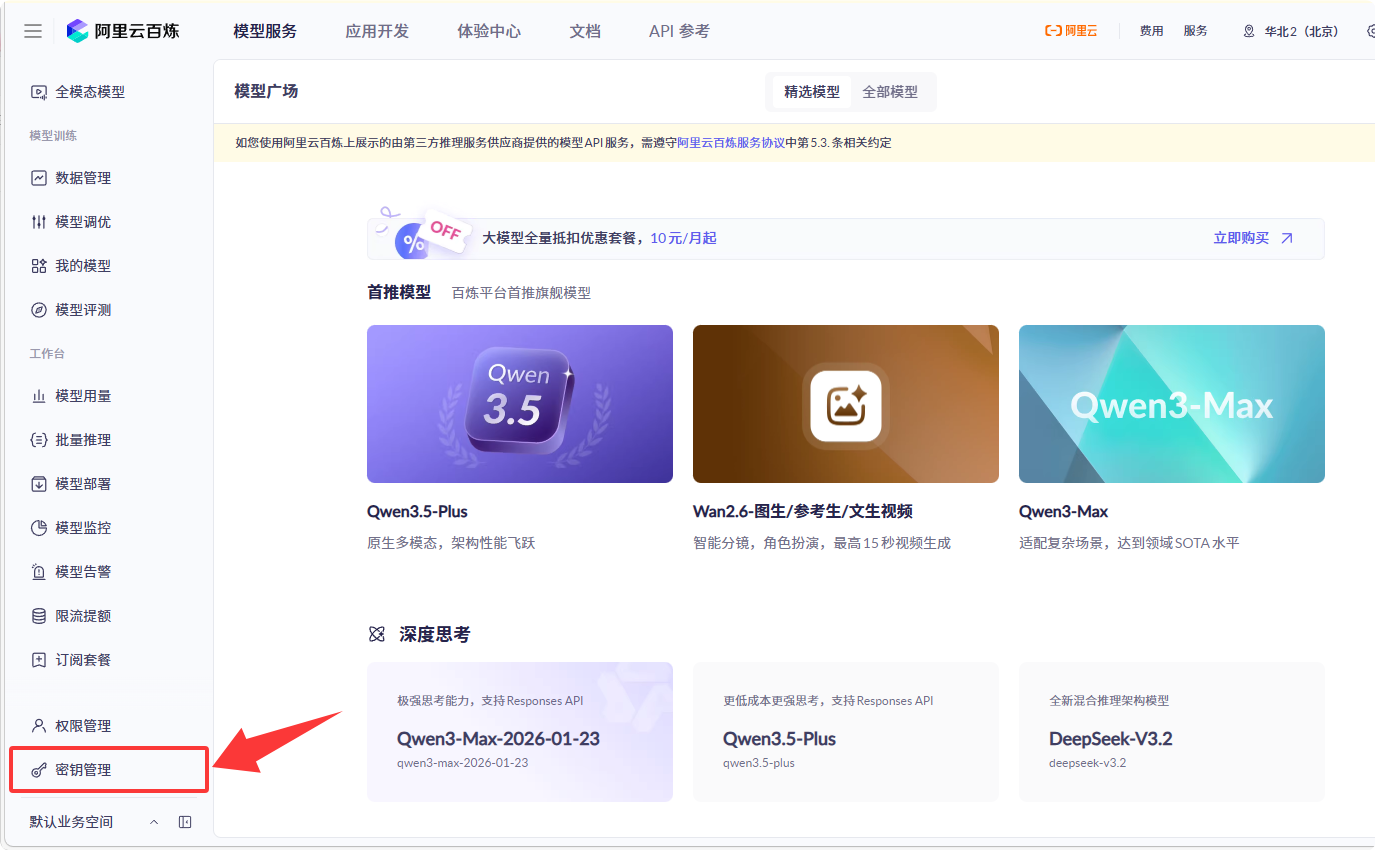

我使用的是阿里 qwen3.5plus 因为他有免费额度()

打开 阿里大模型服务平台百炼控制台 登录一下

点击 密钥管理 –创建API Key

复制 API Key 等一会要用

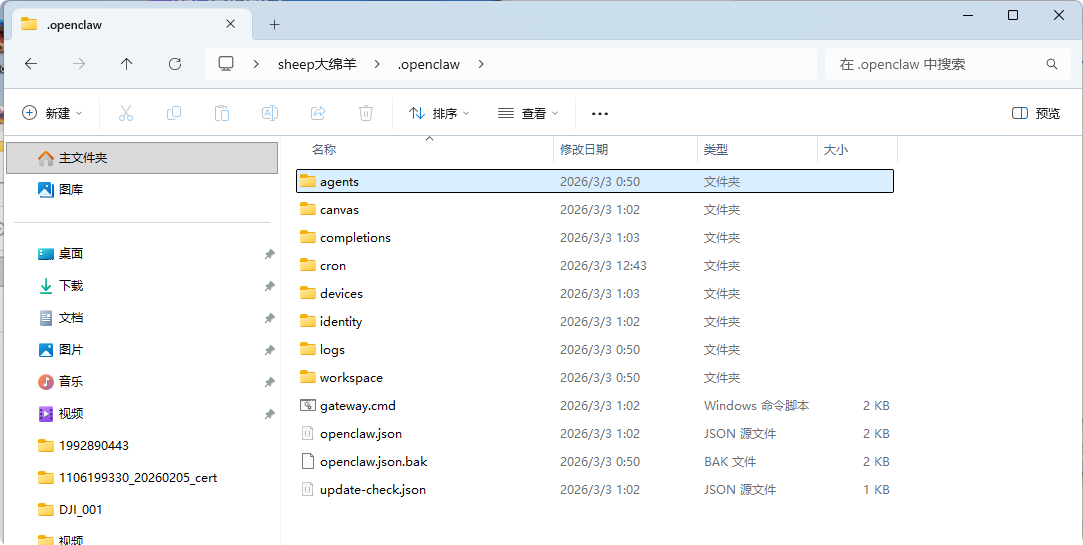

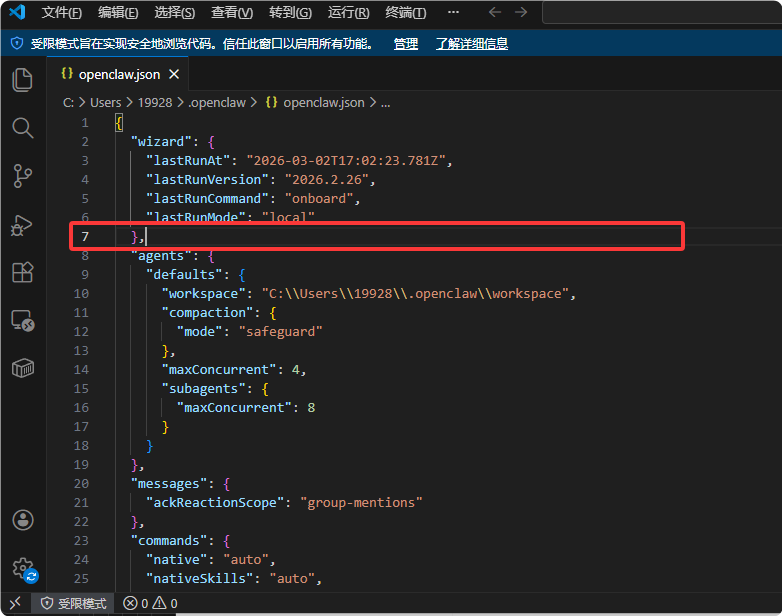

打开 C:\Users\电脑用户名.openclaw 的配置文件

打开 openclaw.json 在文件中的大概第7行的地方

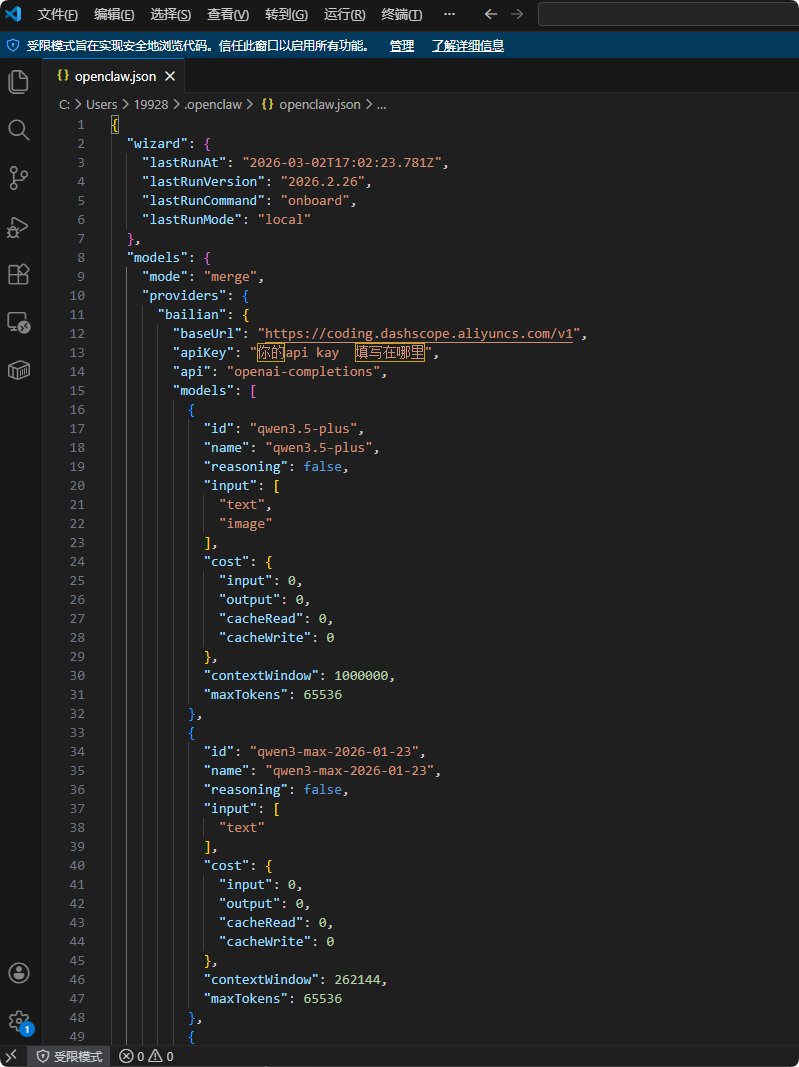

复制

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "你的api kay 填写在哪里",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": [

"text",

"image"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

},

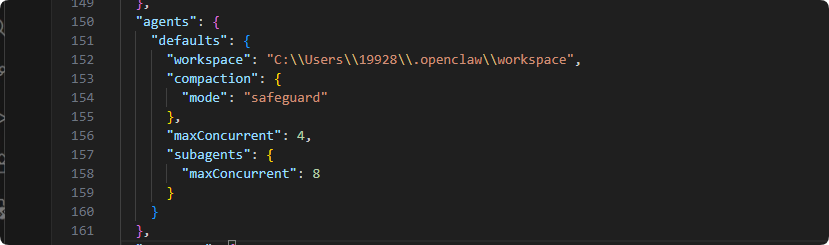

在往下滑找到 agents

填写

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

},

"workspace": "C:\\Users\\19928\\.openclaw\\workspace"

}

},primary 代表 默认模型

models是可选模型

workspace填写你的真实的路径,复制就好了

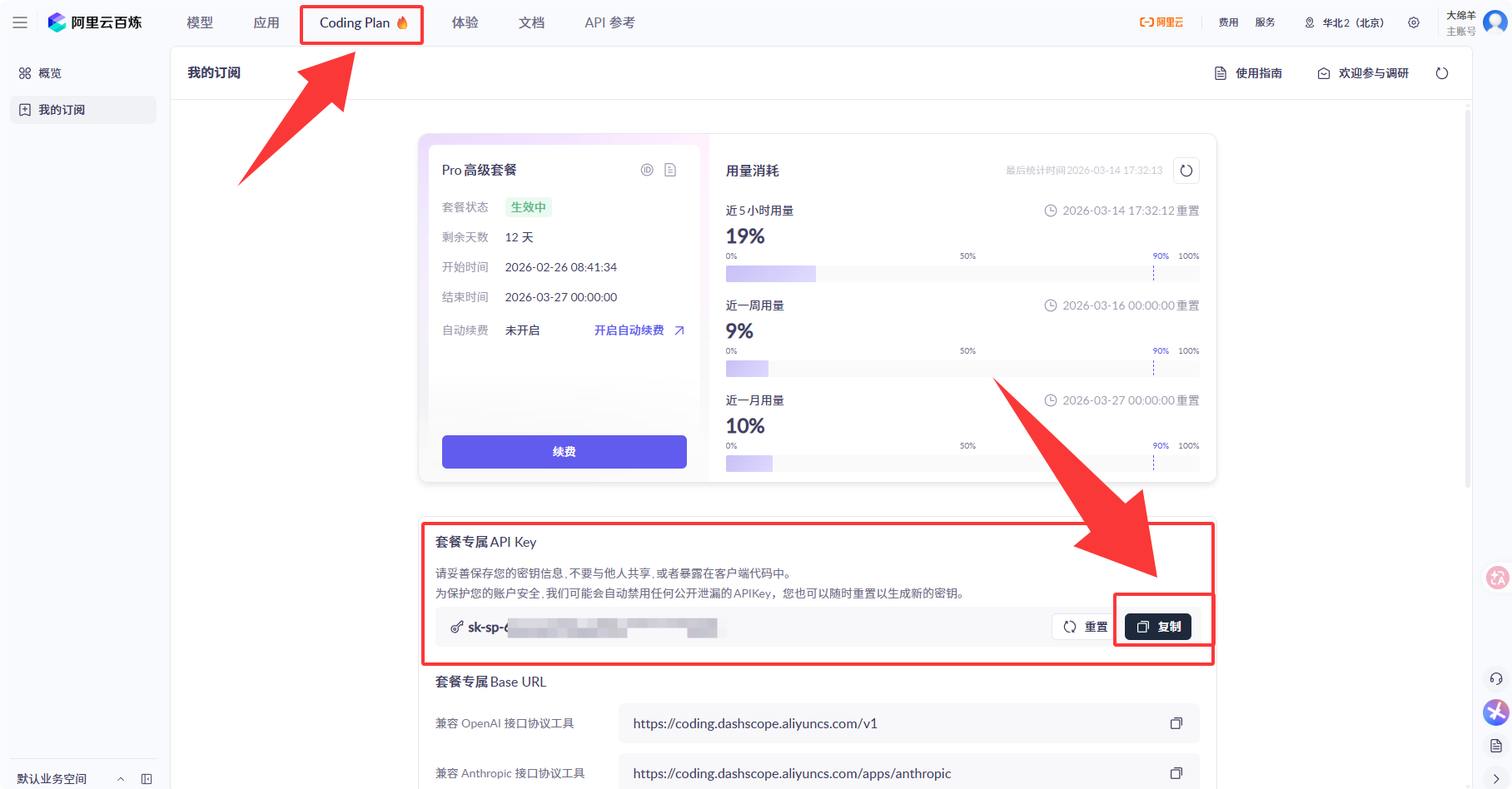

如果您使用的是阿里 Coding Plan 的话key是独立的他的位置在顶部导航的Coding Plan 页面

密钥开头是sk-sp-xxxxxxxxx 才是正确的

完工

这一套配置下了OpenClaw 基本上是可以正常使用了 使用 openclaw gateway 命令打开OpenClaw 在聊天框发送内容(大模型不一定要使用阿里云的 DeePseek,Claude,Open Ai 等等都可以使用)

ojbk测试成功

我为什么不用 WSL2

你可能在其他教程里看到,OpenClaw 官方推荐 Windows 用户走 WSL2(Linux 子系统)。确实,WSL2 兼容性更好,高级功能支持更完整。但对于我们这种”先跑起来看看效果”的快速验证场景,WSL2 有点杀鸡用牛刀了:

- 要装 Ubuntu 子系统,多一层环境维护

- systemd 配置、网络桥接、端口转发……折腾半天

- 我只是想先看个效果,不是要生产部署

所以这篇教程走的是 Windows 原生路线:装 Node.js → 装 OpenClaw → 跑 Onboarding → 接 Qwen,全程在 PowerShell 里搞定,20 分钟足够。

Ps: 如果你后续打算长期使用 OpenClaw,或者需要浏览器自动化、定时任务等高级功能,建议还是迁移到 WSL2 环境。原生 Windows 跑基础对话和工具调用没问题,但部分 Linux 原生的 Skills 可能会有兼容问题。好消息是 OpenClaw 的配置文件(openclaw.json)可以直接复制到 WSL2 环境复用,不用重新配。

讲个笑话,openclaw的下载速度。。😥

下载?

node安装完后的部署,应该是下载claw的安装包